Künstliche Intelligenz, in Kurzform KI, wird zu einem Rüstungsthema. „Die Kernfrage der Menschheit lautet heute, ob ein weltweites KI-Wettrüsten gestartet oder verhindert werden soll“, heißt es in einem offenen Brief, den – als die Prominentesten – Stephen Hawking, Noam Chomsky und der Hightech-Unternehmer Elon Musk unterschrieben haben. „Sobald eine größere Militärmacht die Entwicklung von KI-Waffen vorantreibt, wird ein weltweites Wettrüsten kaum noch zu verhindern sein“, warnen die über 17.500 Unterstützer des Briefes. Die Technik der Künstlichen Intelligenz habe einen Punkt erreicht, an dem es nur noch wenige Jahre dauere, bis es möglich sei, vollkommen autonome Waffen zu erschaffen. Solche

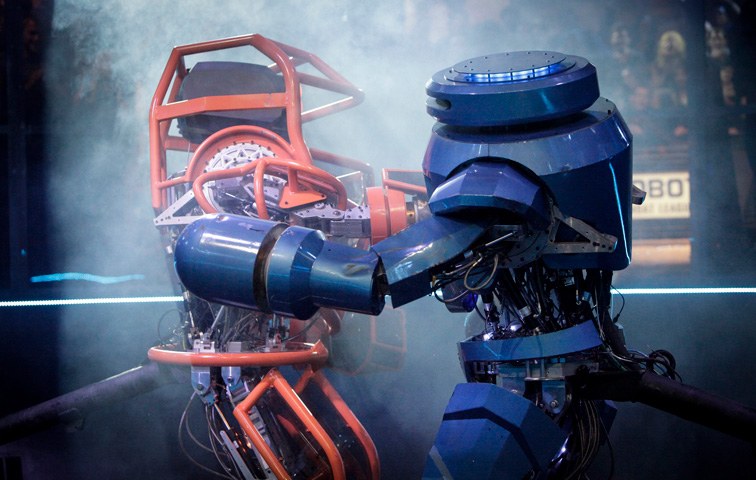

he Waffensysteme gelten nach der Erfindung des Schießpulvers und der Atomwaffen als dritte Revolution der Kriegsführung.Diese Waffen gelten als „Kalaschnikows der Zukunft“. Sie könnten preiswert Menschen töten, Nationen destabilisieren und ganze Bevölkerungsgruppen auslöschen, heißt es in dem Brief. „Es gibt viele Möglichkeiten, wie KI dabei helfen kann, Schlachtfelder für Menschen und vor allem Zivilisten sicherer zu machen, ohne neue Werkzeuge für das Töten von Personen zu schaffen.“ Zu den Unterzeichnern gehören auch deutsche Wissenschaftler – etwa vom Deutschen Zentrum für Luft und Raumfahrt und den Universitäten in Freiburg, Bremen, Leipzig, Chemnitz und Bochum.Auge in Auge mit dem GegnerMilitärs und Politiker sehen in den Waffen den Vorteil, ihre eigenen Soldaten durch die Unerreichbarkeit für den Feind zu schützen. Zudem seien die Waffen preiswert. Die Gegner hingegen sprechen von einer Pervertierung des Krieges – weil die Kampfhandlungen der Konfliktparteien immer mehr entpersonifiziert werden. Mussten sich die Soldaten im Ersten Weltkrieg noch in die Augen schauen, wenn sie sich mit ihren Bajonetten erstachen, waren sie im Zweiten Weltkrieg schon durch die dicken Stahlplatten ihrer Panzer getrennt. Der Ausbau der Luftstreitkräfte führte später schon zu kilometerweiter Distanz zwischen dem, der die Bombe auslöste, und dem, der von ihr getötet wurde. Durch den Einsatz ferngesteuerter Kampfdrohnen wuchs die Entfernung auf tausende Kilometer an.Automatisierte Waffensysteme bringen nun eine ganz neue Größe ins Spiel: Zeit. Die Militärs schicken eine automatisierte Waffe auf den Weg – wann sie tötet, wissen sie nicht genau. Schon die heutigen Einsätze gesteuerter Drohnen zeigen, wie die Sicherheit der eigenen Soldaten zu einem leichtfertigen Einsatz führt.Das Londoner Bureau of Investigative Journalism hat im Drohnenkrieg der USA in Pakistan seit dem Jahr 2004 mindestens 2.500 getötete Personen gezählt – darunter wohl 400 Zivilisten und knapp 200 Kinder. Mit vollkommen selbstständigen Waffensystemen könnte die Hemmschwelle, vermeintliche Feinde ohne Gerichtsurteil zu exekutieren, weiter herabgesetzt werden. Kollateralschäden werden schon heute in Kauf genommen.Die Diskussion um automatisierte Waffensysteme ist nicht neu. Bereits 2012 veröffentlichte die Menschenrechtsorganisation Human Rights Watch eine Studie dazu unter dem Titel Losing Humanity: The Case Against Killer Robots. Darin warnte die Organisation vor der Aushöhlung internationalen Rechts durch den Einsatz selbstständig agierender Drohnen: „Sie wären nicht in der Lage, grundlegende Prinzipien des internationalen Völkerrechts einzuhalten, sie würden Sicherheitsmaßnahmen zum Schutz der Zivilbevölkerung untergraben und wären ein Hindernis, jemanden für etwaige Opfer zur Rechenschaft zu ziehen.“Der rechtliche Status gehört zu den noch vielen offenen Fragen rund um den Einsatz autonomer Waffensysteme. Human Rights Watch fordert in seiner Studie von den Staaten Vorsorgemaßnahmen: „Verbieten Sie die Entwicklung, die Produktion und den Einsatz von vollständig autonomen Waffen mithilfe eines international rechtsverbindlichen Instruments.“ Auch an die Wissenschaftler wird appelliert, sich nicht an der Erforschung autonomer Rüstungsgüter zu beteiligen – der aktuelle Aufruf ist eine Folge des Appells von Human Rights Watch. Ob dieser etwas nützt ist fraglich.„Ächtungsprozesse dauern auf der einen Seite sehr lang, zum anderen steckt der Teufel immer im Detail“, meint Thomas Mickan von der Informationsstelle Militarisierung. Er beschäftigt sich bei der Organisation mit autonomen Waffensystemen und hofft vor allem auf die Eigenverantwortung der Wissenschaftler – auch in Deutschland: „Grundlagenforschung für autonome Waffen wird auch an deutschen Universitäten geleistet.“Ein Beispiel für diese Entwicklung ist der Technologiedemonstrator „Sagitta“. Dabei handelt es sich um eine Nurflüglerdrohne des deutschen Rüstungsunternehmens Cassidian, das heute Teil von „Airbus Defence and Space“ ist. „Sagitta soll nicht zur Produktreife geführt werden, sondern fungiert als Trägersystem, um sich auf den Weg zu autonomen Waffensystemen zu bewegen“, erklärt Thomas Mickan.Besonders die Zusammensetzung der Forschenden hält Mickan für interessant. „Sowohl staatliche Universitäten, Rüstungsfirmen und über die Universität der Bundeswehr auch das Militär sind an der Forschung beteiligt“, sagt der Politikwissenschaftler. Auf der Webseite der Technischen Universität Chemnitz etwa wird Sagitta als „Machbarkeitsstudie einer Nurflügel-Flugzeug-Konfiguration“ beschrieben. Dazu gehört ein „Mehrzweck-Schacht“ für verschiedene Waffen, mit dem auch „neueste Technologien für geringe Entdeckbarkeit und autonome Flugsysteme“ erforscht werden sollen.Erneut ein Zeichen setzenVertreter des Deutschen Zentrums für Luft- und Raumfahrt aus Braunschweig schreiben zur Aufgabe von Sagitta: „Bei den angestrebten Forschungsarbeiten an unbemannten Luftfahrzeugen ist das spätere Einsatzszenario des Systems durch die Bundeswehr zu berücksichtigen, welches sich insbesondere durch Aufklärungsmissionen (Leichtbau) und Bekämpfung von Bodenzielen in stark geschützten und überwachten Gefechtsräumen (Tarnung) auszeichnet.“ Auch die Technische Universität in München und die Hochschule Ingolstadt sind an der Sagitta-Entwicklung beteiligt. Thomas Mickan von der Informationsstelle Militarisierung glaubt, „dass sich die Forschung an der autonomen Drohne in einen globalen Forschungs- und Rüstungswettlauf einfügt“.So richtet sich der aktuelle Appell gegen die Entwicklung vollautomatisierter Waffensysteme auch an Forscher und Politiker in Deutschland. Es wäre an der Bundesregierung, ein Zeichen zu setzen und sich – wie bei Landminen schon geschehen – für eine internationale Ächtung auszusprechen. Stattdessen sucht das Verteidigungsministerium aktuell nach Kampfdrohnen zum Kauf. Der Schritt hin zu vollautomatisierten Drohnen ist dann nicht mehr weit.Und auch die Universitäten und Forschungseinrichtungen reagieren kaum. Zu den Unterzeichnern des internationalen Appells gehören nur wenige Wissenschaftler aus Deutschland – manche sind sogar an Einrichtungen aktiv, die an Sagitta forschen. Zu einer größeren Diskussion über die Verantwortung von Wissenschaft und die Möglichkeit, militärische Forschung etwa durch Zivilklauseln zu unterbinden, kommt es aber nicht.Das heißt, auch Deutschland ist an der weiteren Pervertierung des Krieges beteiligt. Die automatisierte Kriegsführung stellt eine ganz neue Dimension der Unmenschlichkeit dar – sie braucht nicht mal mehr Menschen zum Töten.