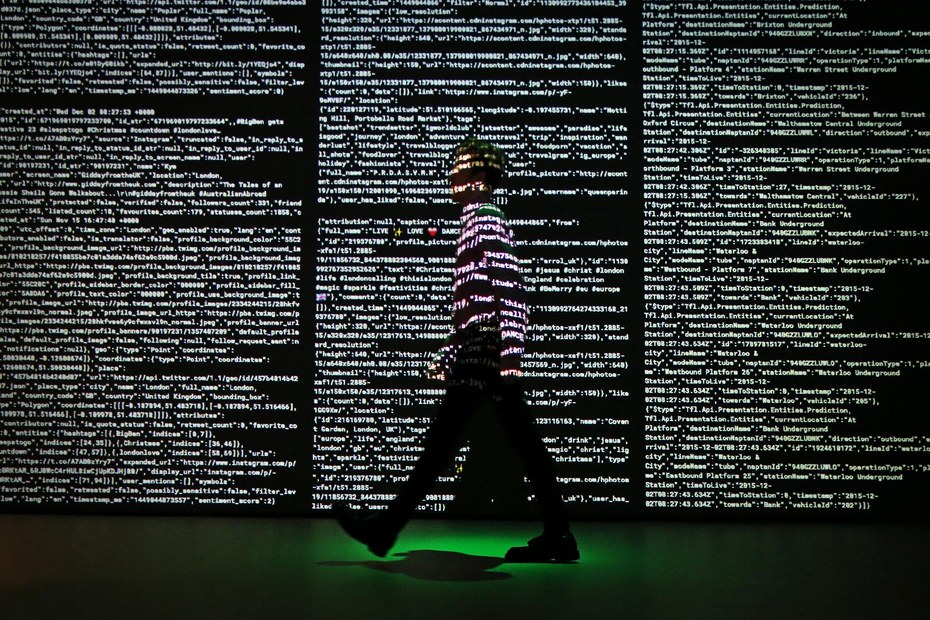

Man darf nicht vergessen, dass sich die gesamte KI-Revolution noch immer jede Sekunde in Luft auflösen könnte. Puff! Das war’s! Denn es gibt eine Schwachstelle in der KI-Entwicklung, einen Engpass, der womöglich zu schmal ist für die großen Träume der Risikokapitalisten und Tech-Barone: Es gibt vielleicht schlicht nicht genügend brauchbare Daten auf der Welt.

„Brauchbar“ kann hier zweierlei bedeuten. Zunächst kann es „brauchbar für Tech-Unternehmen“ heißen. Copyright ist noch immer eine ernste Bedrohung für die Konzerne. Sie haben das Netz leergesaugt, Bücher, Videos, Kunst, Podcasts in ihre Large Language Modelle (LLM) gestopft, damit es lernt, etwas ansatzweise Menschliches nachzuahmen. Doch viele di

h viele dieser Dinge gehören Menschen, sie haben Rechte daran. Einige von ihnen klagen derzeit, und sollte ein Gericht entscheiden, dass Tech-Unternehmen nicht einfach die Arbeit von Autor:innen oder Künstler:innen stehlen dürfen, dann war’s das. LLM-KI ist derzeit sowieso noch Verlustgeschäft und wenn die Unternehmen auch noch die Urheber für ihre Werke entschädigen müssen, dann bricht das Kartenhaus endgültig zusammen. Die Daten sind zwar da, aber außer Reichweite – eine Tantalosqual.Doch die zweite Bedeutung für „brauchbar“ ist noch interessanter, weil grundlegender. Denn derzeit ist unsicher, ob es genug Daten gibt, die überhaupt „brauchbar für KI-Modelle“(!) sind, bevor Urheberrecht auch nur ins Spiel kommt. Dass Tech-Unternehmen das „Netz leergesaugt“ haben, ist keine Floskel: Sie haben das gesamte Internet geplündert, jede verwendbare Zeile Text aufgebraucht, um die neueste Generation der KI-Modelle zu erzeugen. Und schon das war nicht genug!Für GPT-4, die aktuellste Version von OpenAIs KI, musste das Unternehmen zusätzlich noch über eine Million Stunden YouTube-Videos in Texte transkribieren, um den Datenhunger des Systems zu stillen. Und das in vollem Bewusstsein, dass das gegen YouTubes Regeln verstößt, wie eine großartige Recherche der New York Times herausfand. Klagen kann YouTube-Besitzer Google allerdings nicht, weil sie exakt dasselbe getan haben, um ihre Modelle zu trainieren, was nebenher auch einfach ziemlich lustig ist. Facebooks Mutterkonzern Meta spielte auch kurzzeitig mit dem Gedanken, einfach Simon & Schuster zu kaufen, einen der größten Verleger der USA, um legal an die dort verlegten Bücher zu kommen. Am Ende beschloss man jedoch, dass das zu aufwendig sei und man lieber Urheberrecht ignorieren solle, so wie die anderen Tech-Giganten auch. Gesetze sind eher was für Normalsterbliche.Bis zum Kollaps der Künstlichen IntelligenzEs ist extrem schwer zu sagen, wie viele Daten künftige KI-Modelle benötigen. Fest steht allein, dass es ein Vielfaches der derzeitigen Generation sein wird. Und Stand jetzt gibt es dafür schlicht nicht genug Text auf der Welt. Denn um menschliche Arbeit und Kunst imitieren zu können, brauchen sie das Original, sie brauchen uns. Tech-Unternehmen saugen unsere Kreativität aus dem Netz ab, um sie uns dann zurückzuverkaufen im 20-Euro-Monatsabo.Sie hoffen nun, dass sie den Daten-Engpass überwinden könnten, indem sie die nächste KI-Generation mit KI-generierten Daten trainieren. Studien haben gezeigt, dass solch eine Kreislaufwirtschaft dieselben Probleme aufweist wie jede andere inzestuöse Beziehung: Mit jeder weiteren Generation treten immer größere Defekte auf, bis es letztendlich zum Model Collapse kommt und sie vollständig unbrauchbar werden. Der Technologie-Kritiker Jathan Sadowski beschrieb das Ganze treffend als „Habsburg KI“, nach dem Königshaus Habsburg, das so lange untereinander heiratete, bis größere Teile der Familie vollständig deformiert waren.Das Deprimierende an diesem Vergleich ist jedoch, dass die Habsburger trotz eines quasi kreisförmigen Stammbaums lange über große Teile von Europa herrschten. Dass KI womöglich auf Dauer zu schierer Mittelmäßigkeit verdammt ist, bedeutet also nicht, dass sie nicht dennoch eine Gefahr darstellt oder Bosse aufhören, mit baldiger Vollautomatisierung zu drohen. Hier bleibt wahrscheinlich trotzdem alles beim Alten.